Mochi 1是什么?

Mochi 1 是由AI公司 Genmo 推出的最新开源视频生成模型,被认为是当前最先进的开放视频生成系统之一。Mochi 1 专注于生成高保真动作视频,同时高度遵循文本提示。该模型在动作流畅度、物理模拟(如流体、毛发等)以及人物动作的一致性上表现出色。

Mochi 1 在 480p 分辨率下运行,年底前,Genmo将发布完整版的 Mochi 1,其中包括 Mochi 1 HD。Mochi 1 HD 将支持 720p 视频生成,具有更高的保真度和更流畅的运动。

Mochi 1的功能特性:

高质量运动生成:Mochi 1 生成的视频遵循物理运动规律,动作自然流畅,支持逼真的人物表情与动作。精准的提示控制:用户可以通过详细的文本提示控制生成的视频内容,确保角色、场景和动作高度契合提示。一致性与连贯性:Mochi 1 能生成一致、连贯的人物动作和表情,解决了生成视频中的“拟人不协调”问题。开放性与易用性:Mochi 1 是开源的,用户可以通过 GitHub 或 HuggingFace 下载模型,并在 Genmo 提供的 Playground 平台上免费试用。模型架构基于 Asymmetric Diffusion Transformer,设计简单且易于开发者使用和扩展。 Mochi 1的性能评估

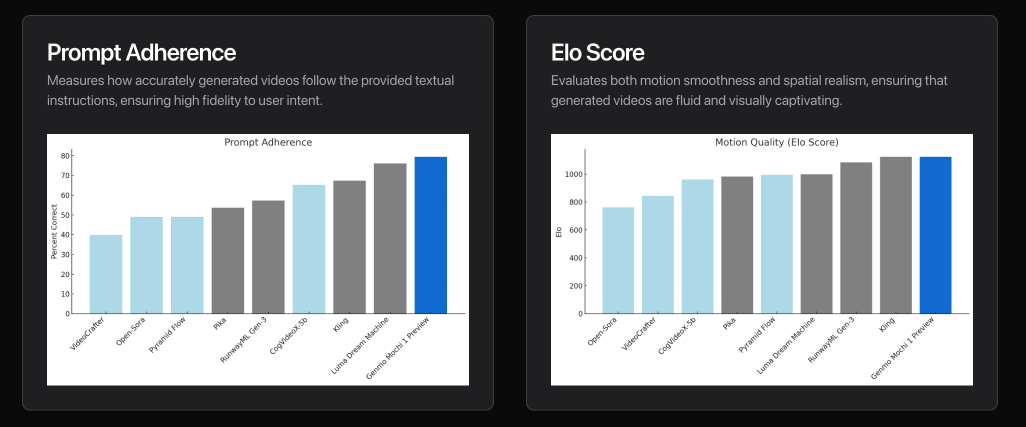

Mochi 1的性能评估

Mochi 1的适合人群:

开发者和研究人员:Mochi 1 提供了视频生成领域的前沿技术,适合研究和开发更复杂的生成应用,尤其是需要先进视频生成技术的研究团队。创意工作者和艺术家:通过该模型,艺术家和内容创作者可以利用 AI 生成高质量的视频内容,将他们的创意转化为视觉效果,尤其适用于广告、影视和动画领域。产品开发者和工程师:Mochi 1 开放了丰富的工具和资源,企业和个人开发者可以将该模型集成到自己的应用中,应用于娱乐、教育、广告等多个领域的产品开发。

如何体验Mochi 1?

Genmo已在HuggingFace开放了Mochi 1 的模型权重和架构,也提供了在线体验服务:

在线体验Mochi 1:https://www.genmo.ai/playHuggingFace模型:https://huggingface.co/genmoGitHub代码库:https://github.com/genmo/models